Construimos las autopistas digitales por donde viaja la información de su empresa. Sin tuberías, no hay datos.

El dicho más famoso en ciencia de datos es real: "Si entra basura, sale basura". De nada sirve tener el mejor modelo de IA si los datos que lo alimentan están sucios, incompletos o desactualizados.

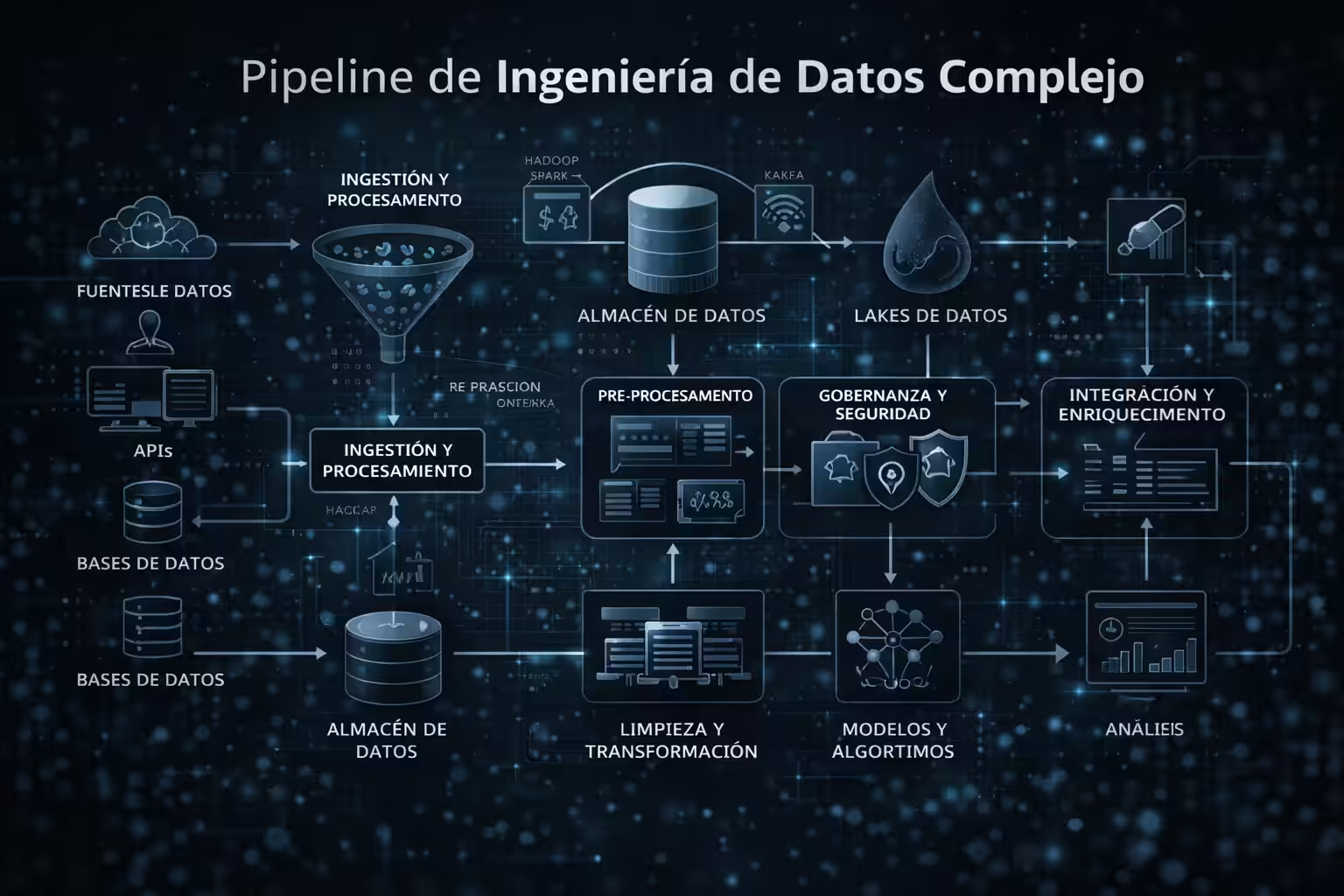

La Ingeniería de Datos es el trabajo "sucio" pero vital de conectar sistemas, mover bits, limpiar registros y garantizar que la información esté disponible y confiable para los analistas de negocio.

Diseñamos sistemas que crecen con usted.

Extracción, Transformación y Carga. Automatizamos el movimiento de datos desde sus fuentes operativas hasta su bodega de datos para análisis.

Diseño de modelos dimensionales (Kimball) optimizados para consultas analíticas rápidas en SQL.

Almacenamiento masivo y económico para datos crudos no estructurados (logs, imágenes, JSONs) listos para Machine Learning.

Implementación de tests automáticos que alertan si los datos llegan nulos, duplicados o fuera de rango. Confianza total.

¿Todavía tiene un servidor físico ruidoso en la oficina acumulando polvo? Es hora de migrar.

Es como una tubería de acueducto, pero digital. Es el conjunto de procesos automáticos que llevan el dato desde la fuente (ej: su CRM) hasta el destino (ej: un reporte), transformándolo y limpiándolo en el camino.

El modelo de la nube es OPEX (Gasto Operativo) en lugar de CAPEX (Inversión de Capital). No paga millones por un servidor por adelantado, paga mensualmente por lo que usa. A largo plazo, suele ser más eficiente.

Batch es procesar datos en lotes (ej: cada noche). Streaming es en tiempo real (milisegundos). El Streaming es más costoso y complejo; nosotros le asesoramos si realmente lo necesita o si Batch es suficiente.

Construimos la infraestructura que su negocio necesita para escalar.

Diseñar Arquitectura