Existe una gran brecha entre entrenar un modelo que funciona en la laptop de un científico de datos y desplegar un sistema predictivo robusto que impacte la línea de fondo de una empresa. La mayoría de los proyectos de Inteligencia Artificial (cerca del 85% según Gartner) fracasan antes de llegar a producción.

¿Por qué sucede esto? Generalmente, por falta de alineación con el negocio, mala calidad de datos o infraestructuras incapaces de soportar el ciclo de vida del ML (MLOps). En esta guía, desglosaremos cómo hacerlo correctamente.

1. Definición del Problema (No empiece con el Algoritmo)

El error número uno es decir: "Queremos usar Redes Neuronales". La tecnología es el medio, no el fin. Empiece formulando una pregunta de negocio clara:

- No diga: "Quiero un modelo de churn".

- Diga: "Quiero reducir la fuga de clientes en un 5% identificando a los usuarios en riesgo 30 días antes de que se vayan".

2. Preparación de Datos: La realidad sucia

Los algoritmos aprenden de ejemplos. Si los ejemplos son malos ("Garbage In"), las predicciones serán malas ("Garbage Out"). Esta etapa consume el 80% del tiempo del proyecto e incluye:

- Limpieza: Tratar valores nulos y duplicados.

- Feature Engineering: Crear nuevas variables que aporten valor (ej: convertir "fecha de compra" en "días desde la última compra").

- Balanceo: Asegurar que el modelo vea suficientes ejemplos de cada caso (ej: casos de fraude vs no fraude).

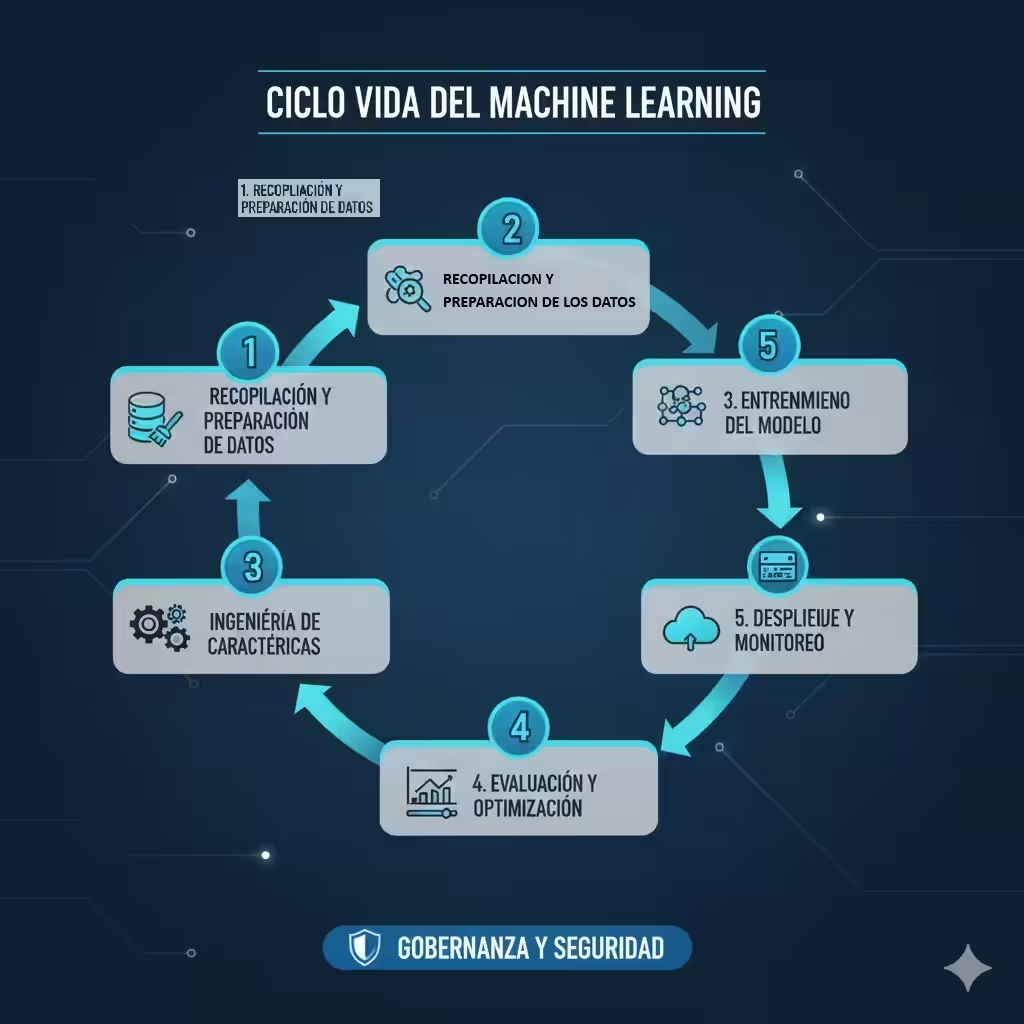

3. Del Laboratorio a la Producción (MLOps)

Aquí es donde los proyectos mueren. Un modelo en un archivo Jupyter Notebook no sirve de nada. Necesitamos "productivizarlo".

| Entorno de Laboratorio | Entorno de Producción |

|---|---|

| Datos estáticos (CSV flat files) | Flujos de datos en tiempo real o batch automáticos. |

| Métricas de error académico (MSE, LogLoss) | KPIs de negocio (Dinero ahorrado, Conversión). |

| Gcorre en una sola máquina manual. | Escalable, APIs REST, Contenedores Docker. |

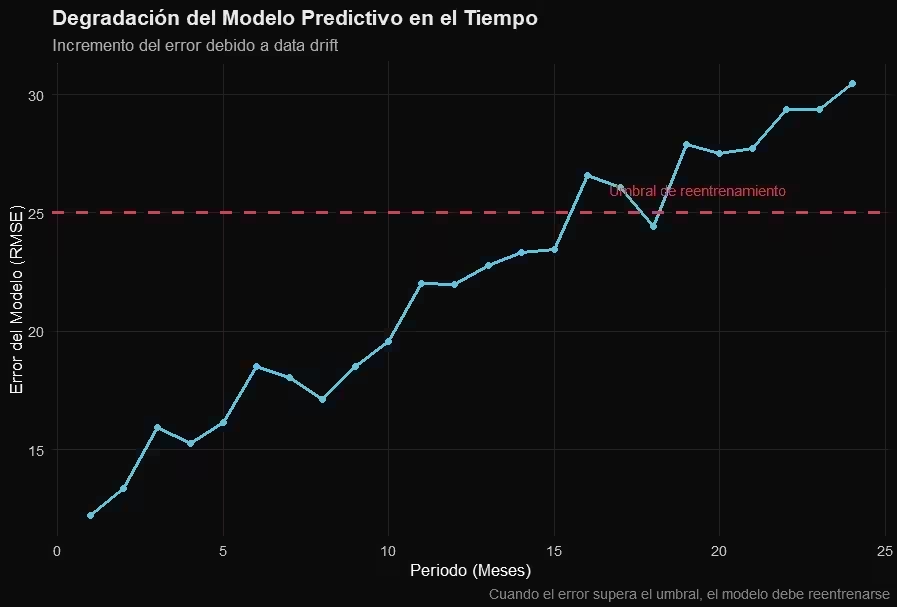

4. Monitoreo y "Data Drift"

A diferencia del software tradicional, el software de ML se degrada con le tiempo. El comportamiento de los clientes cambia (ej: una pandemia, una crisis económica). A esto se le llama "Concept Drift".

🔍 Qué monitorear post-lanzamiento

- Precisión del Modelo: ¿Sigue acertando como al principio?

- Distribución de los Datos: ¿Los datos de entrada hoy se parecen a los de hace 6 meses?

- Latencia: ¿El modelo tarda demasiado en responder?

Conclusión

Implementar modelos predictivos es un viaje de mejora continua. No busque la perfección en la primera versión; busque utilidad. Un modelo simple que se usa hoy es infinitamente mejor que un modelo complejo que nunca sale a la luz.